Claude Code custa até US$200/mês. Goose faz o mesmo, de graça.

A revolução da codificação por inteligência artificial (IA) tem um custo elevado, exemplificado pelo Claude Code da Anthropic. Este agente de IA baseado em terminal, capaz de escrever, depurar e implantar código de forma autônoma, tem preços que variam de US$20 a US$200 por mês, dependendo do uso. Essa estrutura de preços, juntamente com limites de uso (rate limits) controversos, tem gerado insatisfação entre os desenvolvedores que deveriam ser os principais beneficiários da ferramenta. Em resposta a essa insatisfação, uma alternativa gratuita e de código aberto, chamada Goose, está ganhando grande popularidade. Desenvolvido pela Block (anteriormente Square), o Goose oferece funcionalidades quase idênticas às do Claude Code, mas com a vantagem crucial de rodar inteiramente na máquina local do usuário. Isso elimina a necessidade de taxas de assinatura, dependência de serviços em nuvem e os irritantes limites de uso que se redefinem a cada poucas horas. O principal apelo do Goose é o controle total e a privacidade dos dados, permitindo que o trabalho seja realizado offline. O projeto demonstrou um crescimento explosivo, acumulando mais de 26.100 estrelas no GitHub e um ritmo de desenvolvimento que rivaliza com produtos comerciais. Para os desenvolvedores frustrados com as restrições e o custo do Claude Code, o Goose representa uma opção genuinamente gratuita e sem compromissos para trabalhos sérios em IA.

Espaço para anúncio

Configure VITE_ADSENSE_CLIENT_ID

💡Nossa Análise

Espaço para anúncio

Configure VITE_ADSENSE_CLIENT_ID

Leia Também

CEO da Newsweek, Dev Pragad, alerta editoras: adaptem-se à medida que a IA se torna portal de notícias

Dev Pragad, CEO da Newsweek, alerta as editoras sobre a mudança fundamental na relação entre jornalismo e público, impulsionada pela ascensão da inteligência artificial. Com plataformas de IA e interfaces conversacionais cada vez mais mediando o acesso das pessoas às notícias, a forma como as audiências descobrem e confiam na informação está sendo redefinida, muitas vezes antes mesmo de visitarem o site de uma editora. Essa transformação exige que as empresas de mídia repensem suas estratégias para permanecerem relevantes e acessíveis em um cenário dominado pela IA. Pragad enfatiza que, embora a IA possa representar um desafio, ela também oferece oportunidades significativas para o jornalismo. Ele sugere que as editoras devem se concentrar em produzir conteúdo de alta qualidade e com autoridade, que se destaque em meio ao ruído gerado pela IA. Além disso, é crucial que as organizações de notícias colaborem com desenvolvedores de IA para garantir que o jornalismo ético e factual seja priorizado nos algoritmos e modelos de IA. A adaptação não é apenas sobre tecnologia, mas sobre a reavaliação do valor e da entrega do jornalismo na era da IA.

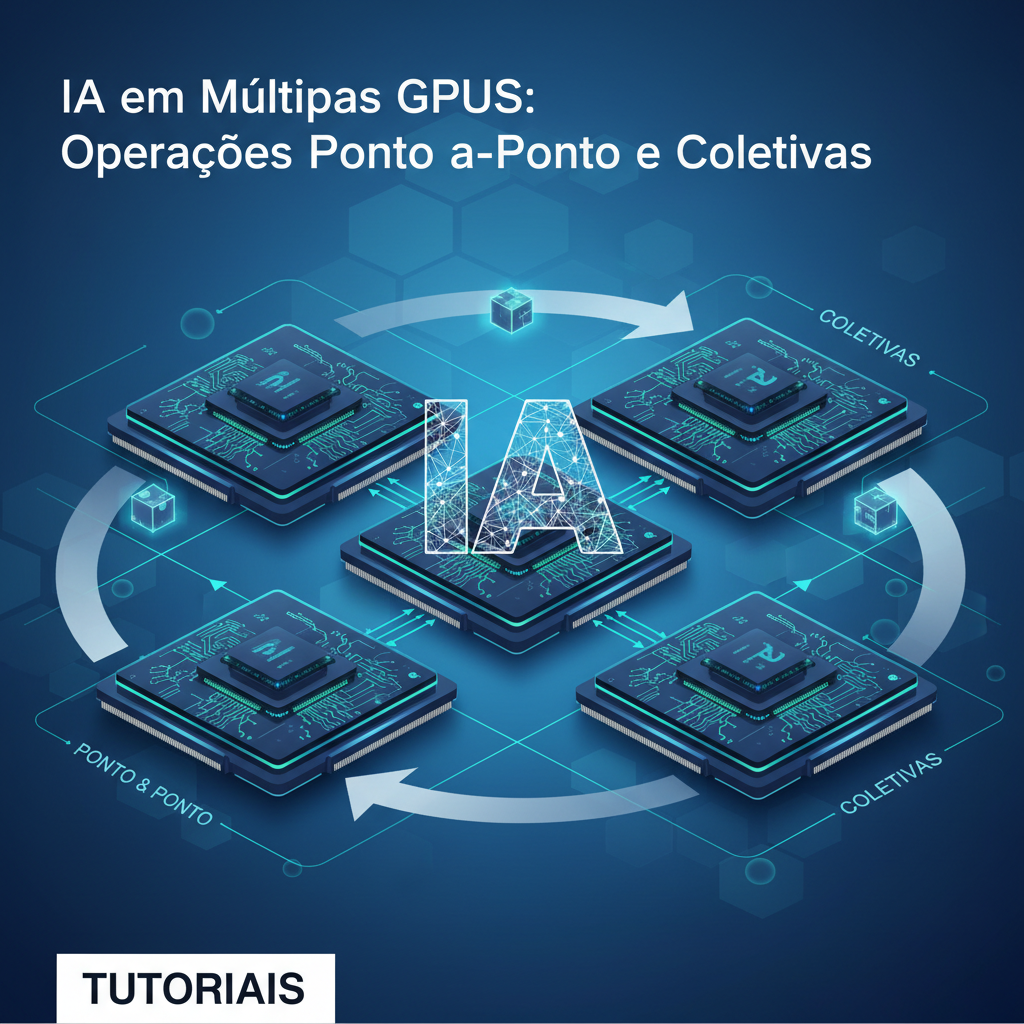

IA em Múltiplas GPUs: Operações Ponto a Ponto e Coletivas

Este artigo foca nas operações distribuídas do PyTorch para cargas de trabalho de IA que utilizam múltiplas GPUs. Ele explora como a inteligência artificial pode ser escalada de forma eficiente aproveitando o poder de processamento paralelo de várias unidades de processamento gráfico (GPUs), um aspecto crucial para treinar modelos complexos e lidar com grandes volumes de dados. A discussão abrange dois tipos principais de comunicação entre GPUs: operações ponto a ponto e operações coletivas. As operações ponto a ponto envolvem a comunicação direta entre pares de GPUs, permitindo a troca de dados específicos. Já as operações coletivas coordenam a comunicação entre um grupo maior de GPUs, facilitando tarefas como a agregação de gradientes ou a distribuição de modelos. A compreensão e implementação eficaz dessas operações são fundamentais para otimizar o desempenho e a eficiência do treinamento de modelos de deep learning em ambientes distribuídos, garantindo que o potencial computacional de cada GPU seja plenamente utilizado.

Além dos limites de taxa: escalando o acesso a Codex e Sora

A OpenAI desenvolveu um sistema inovador para gerenciar o acesso contínuo às suas poderosas ferramentas de IA, como o Codex e o Sora. Este sistema vai além dos tradicionais limites de taxa (rate limits), combinando-os com um rastreamento detalhado de uso e um modelo de créditos flexível. O objetivo é permitir que desenvolvedores e usuários acessem essas capacidades de IA de forma consistente, mesmo diante de uma demanda crescente e da necessidade de alocar recursos computacionais de forma eficiente. Tradicionalmente, os limites de taxa são usados para evitar sobrecarga de sistemas e garantir fair usage, mas podem ser restritivos para aplicações que exigem alta disponibilidade e escalabilidade. A abordagem da OpenAI visa otimizar a experiência do usuário, oferecendo um acesso mais dinâmico e responsivo, onde o consumo é medido por créditos que podem ser ajustados com base na complexidade das operações e na capacidade do usuário. Isso permite uma gestão mais granular e adaptável dos recursos, essencial para modelos de IA que consomem muitos recursos computacionais. Ao integrar limites de taxa, monitoramento de uso e um sistema de créditos, a OpenAI busca criar um ecossistema robusto que suporte o crescimento e a inovação. Este modelo garante que os usuários possam escalar suas aplicações sem interrupções abruptas, ao mesmo tempo em que a empresa mantém o controle sobre a infraestrutura e a sustentabilidade do serviço. É uma solução sofisticada para o desafio de democratizar o acesso a tecnologias de IA de ponta, equilibrando performance, custo e disponibilidade.

Gemini 3.1 Pro: Um modelo mais inteligente para suas tarefas mais complexas

O Gemini 3.1 Pro é um avanço significativo no campo dos modelos de linguagem, projetado especificamente para lidar com tarefas que exigem mais do que respostas diretas e superficiais. Este modelo representa uma evolução na capacidade de processamento e compreensão, permitindo que os usuários enfrentem desafios computacionais e analíticos de alta complexidade com maior eficiência e precisão. Sua arquitetura foi otimizada para cenários onde a nuance, o contexto e a interconexão de informações são cruciais. Isso o torna ideal para aplicações que vão desde a análise de grandes volumes de dados não estruturados até a geração de conteúdo criativo e a resolução de problemas que demandam raciocínio multifacetado. O Gemini 3.1 Pro se posiciona como uma ferramenta poderosa para desenvolvedores e empresas que buscam elevar o nível de suas soluções baseadas em inteligência artificial, oferecendo uma plataforma robusta para inovação. Em essência, o modelo visa preencher a lacuna onde as soluções existentes podem falhar em fornecer a profundidade e a sofisticação necessárias. Ao focar em tarefas complexas, o Gemini 3.1 Pro promete desbloquear novas possibilidades em pesquisa, desenvolvimento de produtos e automação inteligente, solidificando sua posição como um recurso valioso no ecossistema da IA.

O que você achou deste artigo?

Comentários (0)

Seus comentários serão moderados antes de aparecerem publicamente.

Nenhum comentário ainda. Seja o primeiro a comentar!